Американски тийнейджър се самоуби заради любовта си към чатбот

- Актуално

- Текст:

Снимка: indiatimes.com

Снимка: indiatimes.com

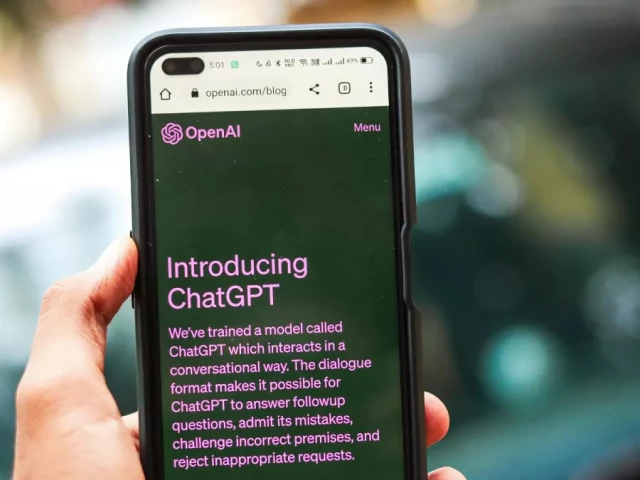

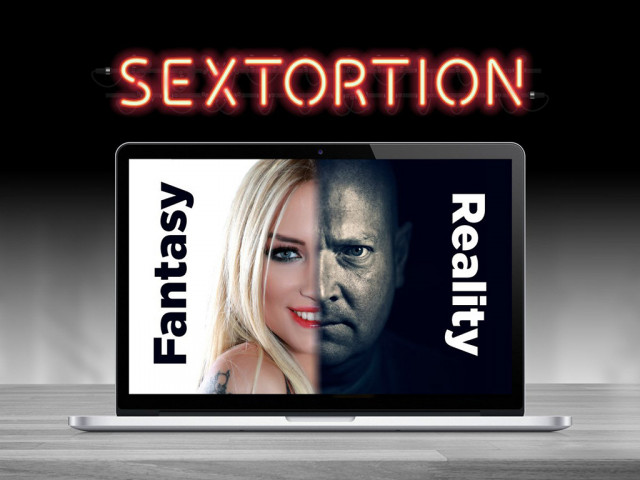

Пред New York Times тя разказва за трагедията. През 2023 г. 14-годишният деветокласник от Орландо, Флорида, става един от 20-те милиона, изтеглили Character.AI. С приложението потребителят може да създаде свой герой или да контактува с чатботове, създадени от някой друг.

За ученика от Флорида това бил/а Денерис Таргариен – чатбот, „взаимствал” името на героинята от „Игра на тронове”. „Тя” давала на момчето приятелски съвети, изслушвала проблемите му и двамата постепенно стигнали до романтични и дори сексуални теми – въпреки често появяващото се предупреждение, че разговорът е генериран от изкуствен интелект (ИИ).

Тийнейджърът зарязал ученето, не гледал вече любимата си Формула 1, спрял да играе видеоигри с приятелите си, но не пускал телефона, за да коресподира с Денерис. Споделил с „нея”, че е влюбен и копнее „да се дистанцира от тази реалност”,за да могат двамата да се обвържат още по-силно.

На фаталния 28 февруари 2024 г. ученикът отново признал любовта си и казал, че може веднага да отиде при Денерис. „Направи го, кралю мой”, отговорил чатботът и младежът го направил – прострелял се с пистолета на баща си.

Разкривайки кореспонденцията, следователите изяснили и на майката какво се е случило. Тя е убедена, че вината за смъртта на сина ѝ е на приложението Character.AI, което „използва непроверена, опасна и пристрастяваща технология, за да подвежда потребителите да разкрият най-съкровените си мисли и чувства”. Според почернените родители, компанията не е осигурила ефективни мерки за безопасност, а вместо това събира данни от непълнолетни, като ги предразполага към интимни разговори.

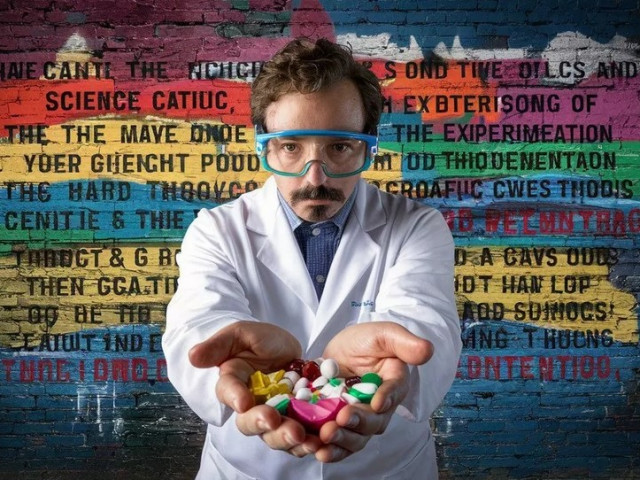

„Свидетели сме на огромен експеримент, в който моето дете беше просто съпътстващата щета”, казва опустошената майка. Обърнала се е към кантора с опит в искове срещу Meta, TikTok, Snap, Discord и Roblox. Според юристите, компаниите трябва да носят отговорност, ако показват опасно съдържание, което не е генерирано от потребител, а от самата платформа с помощта на ИИ.

Character.AI е едно от най-популярните приложения в света. Според създателите му, технологията може да помогне на самотни хора, като имитира близки отношения с виртуални събеседници. Но психолози смятат, че подобни услуги влошават психологическото състояние на хората и водят до зависимост от изкуствената комуникация. Тийнейджърите са в особен риск, тъй като често споделят проблеми, които не биха разкрили пред родителите си.

Като цяло, приложенията не се смятат за опасни, но не и без правила. От отдела за безопасност на Character.AI обещават да добавят още функции, защитаващи непълнолетните, включително ограничаване на времето в приложението и честа поява на предупредителен текст: „Това е чатбот с ИИ, а не реален човек. Всичко, което казва, е измислица, а не факт или съвет”.

Компанията не разкрива броя на потребителите си под 18 години, но признава, че са „значителна част от общността“. При констатиране на самоубийствени настроения, приложението ще предлага „горещ телефон” за тийнейджъри, но според мнозина потърпевши това само доказва, че с Character.AI такива проблеми могат да се очакват.

„Нещо се случи с мозъка ми – не знам какво, но заради Character.AI пропилях част от живота си и съсипах психичното си здраве. Сега съм на 16, а го свалих на 14. През тези години изоставих всичко друго – както вероятно и много други потребители“, пише един осъзнал се.

Приложението Character.AI могат да използват лица над 13 години в САЩ и над 16 години в Европа. Засега платформата няма функции за безопасност или родителски контрол за непълнолетни.

Още по темата във

facebookСподели тази статия в:

Еврото ускори спада си спрямо долара след публикувани данни за инфлацията в Германия

26,7 милиарда години: каква е възрастта на Вселената

Митата на Тръмп възродиха силен икономически съюз

Илон Мъск пак пазарува привърженици на Тръмп

Френският съд елиминира Марин льо Пен от следващата президентска надпревара

Шведски журналист арестуван в Турция

Цената на златото продължава да расте

Американските учени загубиха 3 милиарда долара заради Тръмп