Служител на OpenAI заяви, че ИИ скоро ще нанесе кастрофални щети на човечеството

- Изкуствен интелект

- Текст:

На 4 юни група бивши и настоящи служители на OpenAI публикуваха отворено писмо, което предизвика широк резонанс в научната общност и сред обществеността. Това съобщава Science Times.

Служител на OpenAI каза, че ИИ скоро ще причини катастрофални щети на човечеството

Писмото, подписано и от бившия изследовател на управлението на OpenAI Даниел Кокотайло, съдържа сериозни обвинения срещу компанията. Авторите твърдят, че OpenAI пренебрегва потенциалните заплахи, свързани с развитието на изкуствен общ интелект (AGI) и се стреми да стане пионер в тази област, въпреки възможните рискове за човечеството.

Кокотайло, който се присъедини към OpenAI през 2022 г., изрази опасения, че компанията може да достигне AGI до 2027 г., което според него може да бъде катастрофално.

Той цитира 70% вероятност изкуственият интелект да унищожи човечеството, ако не се вземат подходящи предпазни мерки.

В отвореното писмо се споменава и Джефри Хинтън, известен в научните среди като „кръстникът на AI“, за когото се говори, че е напуснал Google по подобни причини.

Писмото подчертава необходимостта от образоване на обществеността за потенциалните заплахи от ИИ и призовава за по-отговорен подход към развитието на технологиите.

В отговор на публикацията на писмото, OpenAI заяви своя ангажимент към сигурността и заяви, че следва научен подход за справяне с рисковете. Компанията изтъкна своите постижения в създаването на безопасни и продуктивни AI системи.

Темата за AGI остава една от най-противоречивите в областта на изкуствения интелект. За разлика от модерния AI, който работи в рамките на определени параметри, AGI е система с човешки интелект, която може самостоятелно да се учи и решава различни проблеми. Въпреки че AGI остава теоретична концепция, споровете около нея продължават да набират скорост, подчертавайки значението на отговорния подход към бъдещето на AI.

Още по темата във

facebookСподели тази статия в:

Американските учени загубиха 3 милиарда долара заради Тръмп

Правото на отказ от онлайн покупка е право на размисъл

СЗО предложи намаляване на годишния й бюджет с повече от 20 %

Нападателят, ранил пет души в Амстердам, се оказа с фалшиви документи от Донецка област

Голяма американска търговска верига опроверга митническата политика на Тръмп

САЩ настояват и партньорите им да прилагат политика на дискриминация

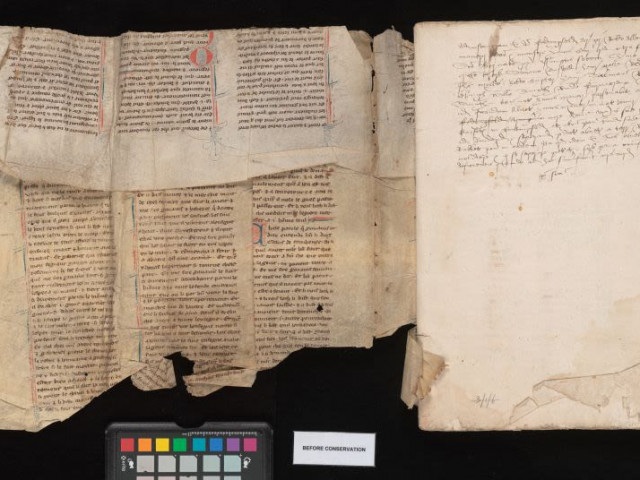

Изгубен ръкопис за крал Артур е прочетен за първи път от 700 години

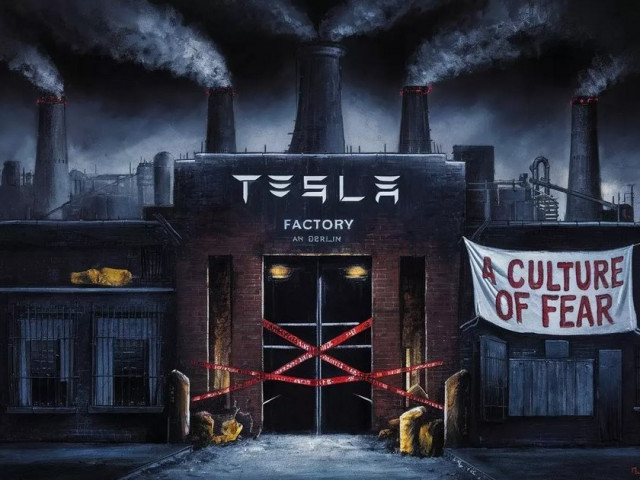

Противници на Tesla обещаха да организират най-мащабния ден на протести по целия свят